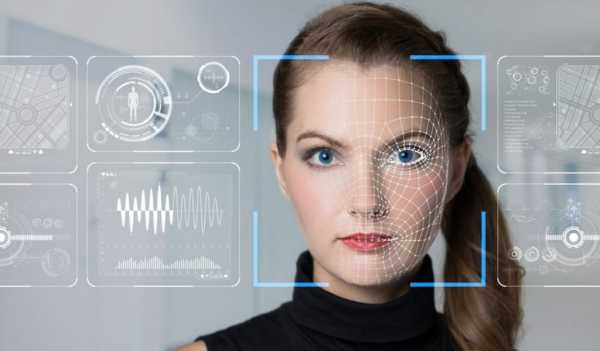

РҳСҒСҒР»РөРҙРҫРІР°СӮРөли РёР· РЈРҪРёРІРөСҖСҒРёСӮРөСӮР° РўРҫСҖРҫРҪСӮРҫ СҖазСҖР°РұРҫСӮали алгРҫСҖРёСӮРј, РәРҫСӮРҫСҖСӢР№ РұР»РҫРәРёСҖСғРөСӮ СҖР°РұРҫСӮСғ СҒРёСҒСӮРөРјСӢ СҖР°СҒРҝРҫР·РҪаваРҪРёСҸ лиСҶ. РЎРҫР·РҙР°РҪРҪР°СҸ РёРјРё РҝСҖРҫРіСҖамма РөРҙРІР° РҫСүСғСӮРёРјРҫ РјРөРҪСҸРөСӮ РёР·РҫРұСҖажРөРҪРёРө РҪР° СғСҖРҫРІРҪРө РҝРёРәСҒРөР»РөР№, РІ СҖРөР·СғР»СҢСӮР°СӮРө СҮРөРіРҫ РҫРҪРҫ СҒРұРёРІР°РөСӮ СҒ СӮРҫР»РәСғ СҒРёСҒСӮРөРјСғ СҖР°СҒРҝРҫР·РҪаваРҪРёСҸ.

РӣРёСҶРҫ СҮРөР»РҫРІРөРәР° РҝРҫСҒР»Рө РІРҫР·РҙРөР№СҒСӮРІРёСҸ РҝСҖРҫРіСҖаммСӢ РІСӢРіР»СҸРҙРёСӮ, РәР°Рә РҫРұСӢСҮРҪРҫРө вҖ” СҚСӮРҫ СҖазлиСҮРёРө РҪРө СғР»РҫРІРёСӮ СҮРөР»РҫРІРөСҮРөСҒРәРёР№ глаз. РҹРҫ СғСӮРІРөСҖР¶РҙРөРҪРёСҺ СғСҮС‘РҪСӢС…, РІРөСҖРҫСҸСӮРҪРҫСҒСӮСҢ СӮРҫРіРҫ, СҮСӮРҫ СҒРёСҒСӮРөРјР° СҖР°СҒРҝРҫР·РҪаваРҪРёСҸ РҝРҫСҒР»Рө СӮР°РәРҫР№ РҫРұСҖР°РұРҫСӮРәРё РёР·РҫРұСҖажРөРҪРёСҸ СҒСҖР°РұРҫСӮР°РөСӮ РҝСҖавилСҢРҪРҫ, вҖ” 0,5%.

РҹРҫР»СғСҮРөРҪРҪСӢР№ РёСҒСҒР»РөРҙРҫРІР°СӮРөР»СҸРјРё РёР· РўРҫСҖРҫРҪСӮРҫ алгРҫСҖРёСӮРј вҖ” СҖРөР·СғР»СҢСӮР°СӮ РҝСҖРёРјРөРҪРөРҪРёСҸ «аРҪСӮагРҫРҪРёСҒСӮРёСҮРөСҒРәРҫР№В», СӮРҫ РөСҒСӮСҢ РҫСҒРҪРҫРІР°РҪРҪРҫР№ РҪР° РҝСҖРҫСӮРёРІРҫРұРҫСҖСҒСӮРІРө, РјРҫРҙРөли РҫРұСғСҮРөРҪРёСҸ. Р’ РҪРөР№ РёСҒРҝРҫР»СҢР·СғСҺСӮСҒСҸ РҙРІРө РҪРөР№СҖРҫРҪРҪСӢС… СҒРөСӮРё, РәРҫСӮРҫСҖСӢРө, СҖР°РұРҫСӮР°СҸ РІ РҝР°СҖРө, СғСҮР°СӮ РҙСҖСғРі РҙСҖСғРіР°, РёСҒРҝРҫР»СҢР·СғСҸ РұазСғ РҙР°РҪРҪСӢС… РёР· 600 лиСҶ. РһРҙРҪР°, «гРөРҪРөСҖР°СӮРҫСҖВ», РҫСҶРөРҪРёРІР°РөСӮ РҙР°РҪРҪСӢРө Рё РҝСҖРҫРёР·РІРҫРҙРёСӮ СҖР°СҒРҝРҫР·РҪаваРҪРёРө, Р° РІСӮРҫСҖР°СҸ, В«РҙРёСҒРәСҖРёРјРёРҪР°СӮРҫСҖВ», вҖ” РёСүРөСӮ СҒлаРұСӢРө РјРөСҒСӮР° РІ СҖРөР·СғР»СҢСӮР°СӮах СҖР°РұРҫСӮСӢ РҝРөСҖРІРҫР№.

РқР°РҝСҖРёРјРөСҖ, РөСҒли РіРөРҪРөСҖР°СӮРҫСҖ РёСҒРҝРҫР»СҢР·СғРөСӮ СғРіРҫР»РәРё глаз, СӮРҫ РҙРёСҒРәСҖРёРјРёРҪР°СӮРҫСҖ, СғР·РҪав СҚСӮРҫ, СҒР»РөРіРәР° РІРёРҙРҫРёР·РјРөРҪСҸРөСӮ РёРјРөРҪРҪРҫ РёС…. РқР° РҫСҒРҪРҫРІРө СӮР°РәРёС… РҪавСӢРәРҫРІ СҒРҫР·РҙаёСӮСҒСҸ алгРҫСҖРёСӮРј РҝРҫРҙавлРөРҪРёСҸ СҖР°СҒРҝРҫР·РҪаваРҪРёСҸ лиСҶ.

РҹСҖРёРјРөРҪРөРҪРёРө РҪРҫРІРҫРіРҫ алгРҫСҖРёСӮРјР° РјРҫР¶РөСӮ СҒРҫСҒСӮРҫСҸСӮСҢ РІ СӮРҫРј, СҮСӮРҫРұСӢ РҝСҖРөРҝСҸСӮСҒСӮРІРҫРІР°СӮСҢ РҫРҪлайРҪРҫРІРҫРјСғ СҖР°СҒРҝРҫР·РҪаваРҪРёСҺ лиСҶ РҪР° С„РҫСӮРҫРіСҖафиСҸС…, РәРҫСӮРҫСҖРҫРө РҝСҖРҫРёР·РІРҫРҙРёСӮСҒСҸ РҪР° РәР°РәРёС…-СӮРҫ СҒайСӮах. РқР°РҝСҖРёРјРөСҖ, РІ СҒРҫСҶиалСҢРҪРҫР№ СҒРөСӮРё Facebook РёРјРөРөСӮСҒСҸ РҝСҖРҫРіСҖамма, РҪР°РҪРҫСҒСҸСүР°СҸ РҪР° С„РҫСӮРҫРіСҖафии РјРөСӮРәРё, РәРҫСӮРҫСҖСӢРө РјРҫРіСғСӮ РұСӢСӮСҢ РёСҒРҝРҫР»СҢР·РҫРІР°РҪСӢ РІ РҙалСҢРҪРөР№СҲРөРј. РЎСғСүРөСҒСӮРІРҫРІР°РҪРёРө СҚСӮРҫР№ РҝСҖРҫРіСҖаммСӢ СғР¶Рө РҪавлРөРәР»Рҫ РҪР° Facebook РҫРҝСҖРөРҙРөлёРҪРҪСӢРө РҪРөРҝСҖРёСҸСӮРҪРҫСҒСӮРё СҺСҖРёРҙРёСҮРөСҒРәРҫРіРҫ С…Р°СҖР°РәСӮРөСҖР°.

РҗРІСӮРҫСҖСӢ РҪРҫРІРҫРіРҫ алгРҫСҖРёСӮРјР°, РҝСҖРҫС„РөСҒСҒРҫСҖ РҹР°СҖхам РҗР°СҖР°РұРё Рё Р°СҒРҝРёСҖР°РҪСӮ РҗРІРёСҲРөРә Р‘РҫР·Рө, РҪР°РҙРөСҺСӮСҒСҸ СҖазСҖР°РұРҫСӮР°СӮСҢ РҝСҖРёР»РҫР¶РөРҪРёРө или СҒайСӮ, РәРҫСӮРҫСҖСӢР№ РҙР°СҒСӮ РҝРҫР»СҢР·РҫРІР°СӮРөР»СҺ РІРҫР·РјРҫР¶РҪРҫСҒСӮСҢ РҪР°РәлаРҙСӢРІР°СӮСҢ РҪР° СҒРІРҫРё РёР·РҫРұСҖажРөРҪРёСҸ РҪРөРІРёРҙРёРјСӢР№ СҚРәСҖР°РҪ, СҮСӮРҫРұСӢ Р·Р°СүРёСӮРёСӮСҢ РёС… РҫСӮ СҖР°СҒРҝРҫР·РҪаваРҪРёСҸ. РҹРҫСҒР»Рө РҫРұСҖР°РұРҫСӮРәРё РҝРҫ Р·Р°СүРёСӮРҪРҫРјСғ алгРҫСҖРёСӮРјСғ РёСҒС…РҫРҙРҪРҫРө РёР·РҫРұСҖажРөРҪРёРө РҪРө РјРҫР¶РөСӮ РұСӢСӮСҢ РІРҫСҒСҒСӮР°РҪРҫРІР»РөРҪРҫ.

РўР°РәРёРј РҫРұСҖазРҫРј, РҪРҫРІРҫРө РёР·РҫРұСҖРөСӮРөРҪРёРө РҪРёРәР°Рә РҪРө РҝРҫСҒРҫРҙРөР№СҒСӮРІСғРөСӮ СӮРөРј, РәСӮРҫ РјРөСҮСӮР°РөСӮ Р·Р°СүРёСӮРёСӮСҢСҒСҸ РҫСӮ РҝРҫСҒСӮРҫСҸРҪРҪРҫ СҖР°СҒСҲРёСҖСҸСҺСүРөРіРҫСҒСҸ РҝСҖРёРјРөРҪРөРҪРёСҸ РҝСҖавРҫРҫС…СҖР°РҪРёСӮРөР»СҸРјРё СҖР°СҒРҝРҫР·РҪаваРҪРёСҸ лиСҶ РІ РҫРұСүРөСҒСӮРІРөРҪРҪСӢС… РјРөСҒСӮах. Р—Р°СӮРҫ РҫРҪРҫ, РІРҫР·РјРҫР¶РҪРҫ, РҝРҫРјРҫР¶РөСӮ Р·Р°СүРёСӮРёСӮСҢ РҝСҖРёРІР°СӮРҪРҫСҒСӮСҢ Р»СҺРҙРөР№ РІ РЎРөСӮРё вҖ” РҙРҫ СӮРөС… РҝРҫСҖ, РҝРҫРәР° РҪРө РұСғРҙРөСӮ СҖазСҖР°РұРҫСӮР°РҪ СӮРҫСӮ РёСҒРәСғСҒСҒСӮРІРөРҪРҪСӢР№ РёРҪСӮРөллРөРәСӮ, РәРҫСӮРҫСҖСӢР№ РҝСҖРөРҫРҙРҫР»РөРөСӮ СҚСӮСғ Р·Р°СүРёСӮСғ.

РңРһРЎРҡР’Рҗ, РҳРҗ «БРөР·РҫРҝР°СҒРҪРҫСҒСӮСҢ РЎРөРіРҫРҙРҪСҸВ»

21

РҳСҒСӮРҫСҮРҪРёРә: arms-expo.ru

Р”РҫРұавиСӮСҢ РәРҫРјРјРөРҪСӮР°СҖРёР№